ChatGPT — чат-бот с искусственным интеллектом — появился в конце ноября 2022 года и стал супер вирусным. Уже к февралю 2023-го его признали самым быстроразвивающимся сервисом в истории — чат пробил порог в 100 млн пользователей. В отдельной статье мы писали, кому ChatGPT угрожает, а кто может его не бояться.

Параллельно росту популярность ИИ множились постироничные шутки в стиле: Страх №346 — тебя заменит искусственный интеллект. Вроде бы, смешно, а, вроде бы, и страшно.

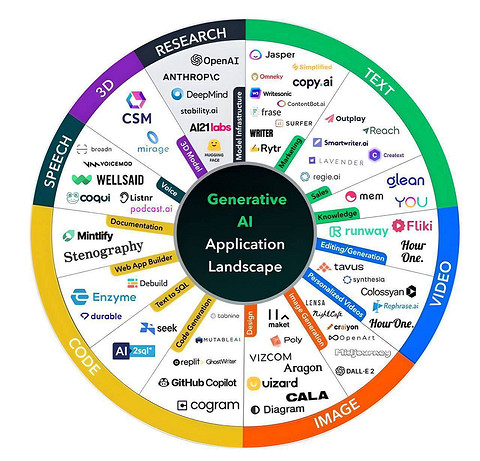

Ведь с одной стороны, искусственный интеллект (ИИ) — это классно. Он может взять на себя рутинную работу или помогать в быстром создании уникального контента. Картинки, тексты, музыка — все, на что у человека может уйти ни один час, ИИ генерирует за пару минут. Достаточно создать правильный запрос. С другой — многозадачность ИИ и то, что его стало так много в нашей жизни, — пугает.

Герои нашей статьи поделились своими мыслями, связанными с реальностью, где люди будут (уже начали) подстраиваться под роботов.

Диана Фомченкова, инженер-конструктор. Москва

«Я — инженер, человек от науки и технологий. Стараюсь быть в курсе всех новых веяний и постоянно пользуюсь программами на основе нейросетей. Например, обрабатываю фото и видео, генерирую изображения и тексты, конвертирую 2D и 3D-модели.

На данном этапе я немного опасаюсь неизвестности, связанной с моей специальностью в будущем. Ведь уже часть работы, которую раньше делали инженеры, делегировали ИИ. В том числе, потому что они эффективнее:

- сокращают время разработки проектов,

- точнее прогнозируют технические параметры,

- снижают вероятность ошибок.

Совершенно точно, что ИИ скоро вытеснит человека из ряда профессий. Например, профильные приложения и сервисы на базе ИИ легко выполняют задачи дизайнера, ретушера, иллюстратора, копирайтера, переводчика и даже части программистов.

Думаю, что главное условие для безопасного внедрения ИИ в нашу жизнь — это разработка надежных и качественных протоколов безопасности в сфере искусственного интеллекта. Пока это условие не создадут, то и страх перед разрастающимся влиянием ИИ никуда не денется».

22 марта 2023 года американский предприниматель, глава Tesla, SpaceX и Twitter Илон Маск написал открытое письмо создателям искусственного интеллекта с просьбой приостановить обучать машины мощным системам.

«Мы призываем все лаборатории, исследующие искусственный интеллект, немедленно прекратить хотя бы на шесть месяцев тренировки систем мощнее GPT-4. Эта пауза должна быть публичной и действительной. Если же подобная приостановка не может быть сделана быстро, правительства государств должны вмешаться и ввести мораторий», — говорилось в письме.

«Должны ли мы создавать то, что может перехитрить нас, сделать ненужными и в итоге заменить? Должны ли мы рисковать потерей контроля над нашей цивилизацией?» — спросил Маск разработчиков ИИ.

Также миллиардер сослался на исследования, согласно которым ИИ с интеллектом, сравнимым с человеческим, представляет опасность для общества.

Андрей Кашкаров, журналист. Москва

«Человека всегда пугало все неопределенное, непредсказуемое, то есть завтрашний день. Этот случае — не исключение. Мои тревоги на счет искусственного интеллекта связаны с бесконтрольностью людей и организаций, которые уже применяют ИИ. Также волнуют перспективы его применения. Вот некоторые страхи и опасности, которые я вижу в разных сферах:

- ИИ в медицине. Одно дело, когда боты используют элементами — систематизируют и анализируют с их помощью данные. Но другое — если ИИ начнет принимать решения вместо дипломированного врача или под номинальным контролем последнего. Уверенности в четкой постановке диагноза в этом случае не будет, поскольку ИИ использует анализ формализуемых данных. Это может стать причиной фатальной ошибки. Также возникает проблема ответственности за некачественную услугу, решение, терапию.

- ИИ в системе безопасности. Искусственный интеллект давно и хорошо применяют в системах наблюдения, контроля и безопасности. Например, обученные программы легко вычисляют по камерам видеонаблюдения — за доли секунды сравнивают заданные картинки с электронной базой. По этому же принципу можно следить за банковскими транзакциями по номерам телефонов, социальным и дисконтным картам и всему, что имеет оцифрованный вид. Значит, все мы станем еще уязвимее.

- ИИ в полиции. Усиление полицейских функций с помощью ИИ понятно. Такое решение облегчает им работу. Но опасность в том, что использует результаты деятельности системы с ИИ все тот же человек. Он может быть не в настроении, иметь специальный заказ, коррупционную составляющую и так далее.

Мне не нравится сама мысль, что кто-то может теоретически следить за другими и пользоваться плодами такой скрытой слежки — будь она личной или коммерческой.

В моей сфере (журналистика) ИИ может выявлять актуальную новостную повестку. При этом читать новости и выбирать главное все равно придется мне. Выезжать на места и перепроверять факты тоже буду я. Если полностью доверить это ИИ, снова возникнет вопрос об ответственности и компенсации за ошибки. Кто будет отвечать?

Что могло бы уберечь от всех этих рисков? Наверное, четкое понимание — кто, как и за что отвечает, какие гарантии государство несет пред гражданином от несанкционированного применения ИИ против людей. Также нужна обратимость явления. Чтобы не получилось, как в фантастических рассказах, когда ИИ выходит из-под контроля — сам начинает создавать себе подобные системы и угрожает жизни человека. Раз таких гарантий нет, ИИ потенциально опасен. Некоторые его элементы можно разрешить к применению, но под контролем уполномоченных структур, жесткой персональной ответственности и общественным контролем».

Александра Веретено, старший преподаватель ОмГУ им ФМ Достоевского. Омск

«Переживания из-за искусственного интеллекта появились почти сразу после того, как тема ИИ стала популярной в научном и технологическом сообществах — в середине 20-го века. Мои личные опасения усилились с развитием глубокого обучения и нейронных сетей. Большинство из них связаны с потенциальными последствиями внедрения ИИ в различные аспекты нашей жизни:

- замена людей на рабочем месте,

- этические вопросы,

- проблемы приватности,

- теоретическая возможность создания супер интеллекта, который может выйти из-под контроля человечества.